Her pazarlamacının veya web geliştiricinin durup düşünmesi gereken bir sayı var: Ocak 2026’da Google’a US12536233B1 numaralı patent verildi. Bu sadece bürokratik bir başvuru değil; dönüşüm oranı, hemen çıkma oranı ve tasarım kalitesine göre açılış sayfalarını puanlayan bir sistemi detaylandırıyor. Ve eğer bir sayfa bu testten geçerse? Google, belirli arama yapan kişiye göre kişiselleştirilmiş bir yapay zeka alternatifi hazırlayabilir. En vurucu nokta? Reklam veren bunu asla bilmeyebilir.

Sektör, patentin kapsamı hakkında endişeleniyor – sadece alışveriş reklamları için mi, yoksa daha kötü bir şey mi? Bu tamamen yanlış bir çerçeveleme. Asıl sismik değişim, patentin neyi kapsadığı değil, yapay zeka tarafından oluşturulan sayfaları yapay zeka aracılarla (bizim adımıza gezinen, alışveriş yapan ve işlem yapan) birleştirdiğinizde neyi mümkün kıldığıdır.

Hem sayfanın yaratıcısının hem de ziyaretçisinin insan dışı olduğu bir web ile karşı karşıyayız. Bunu bir saniye düşünün. Bu, ‘çevrimiçi varlık’ kavramının anlamını tamamen yeniden çerçeveliyor.

Arz Tarafı: Zanaatkârlar Değil, Algoritmalar Tarafından İnşa Edilen Sayfalar

İnternet var olduğundan beri, ‘arz tarafı’ – içeriğin oluşturulması, sayfaların tasarımı – temelde insana aitti. Birisi kodladı. Birisi metni yazdı. Birisi yayına bastı. Bu paradigmaları yıkan üç farklı ama birleşen gelişme var.

Google’ın patenti, elbette, en doğrudan saldırı. Yapay zekanın düşük performanslı açılış sayfalarını dinamik olarak puanlaması ve değiştirmesi için gereken mimariyi açıkça ortaya koyuyor. Değiştirilen sayfalar, kritik olarak, bir arama yapanın tüm geçmişinden – geçmiş sorgular, tıklama davranışları, konum, cihaz verileri – yararlanıyor. Bu sadece kişiselleştirme değil; bu, hiçbir insan reklamcının eşleşemeyeceği bir ölçekte hiper-bireyselleştirme. Search Engine Land’den Barry Schwartz’ın belirttiği gibi, Google “özel açılış sayfaları otomatik olarak oluşturabilir, organik sonuçları değiştirebilir.” Glenn Gabe ise bunu “yapay zeka özetlerinden potansiyel olarak daha tartışmalı” olarak nitelendirdi. Search Engine Journal’dan Roger Montti gibi bazıları, kapsamın alışveriş ve reklamlarla sınırlı olduğunu savunurken, temel teknoloji – sayfaları yapay zeka ile puanlama ve değiştirme – açıkça burada ve işlevsel.

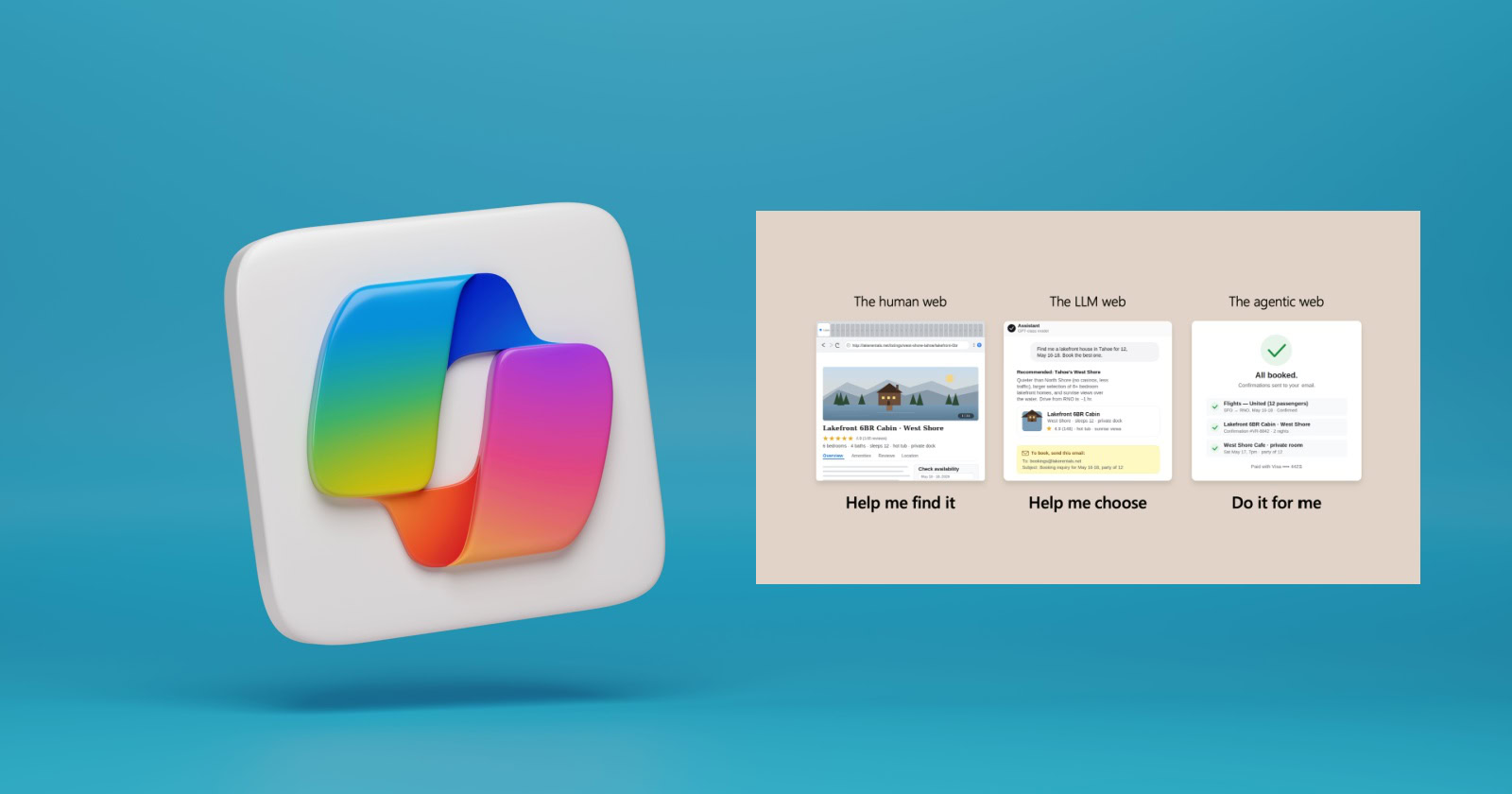

Ancak Google içerik katmanını yeniden yapılandıran tek oyuncu değil. Microsoft’un açık kaynaklı projesi NLWeb, farklı bir yol sunuyor. Mevcut web sitelerini, Schema.org işaretlemesini ve RSS akışlarını kullanarak doğal dil arayüzlerine dönüştürüyor. Bir yapay zeka aracı, NLWeb etkin bir siteye sorgu gönderdiğinde, geleneksel bir sayfa yüklemiyor. Bunun yerine, yapılandırılmış bir soru soruyor ve NLWeb yapılandırılmış bir yanıt döndürüyor. Oluşturulan sayfa kelimenin tam anlamıyla isteğe bağlı hale geliyor.

WebMCP bu çözülmeyi daha da ileri götürüyor. Burada web siteleri, araçlarını tanımlanmış giriş/çıkış şemalarıyla kaydediyor. Yapay zeka araçları, bu araçları fonksiyonlar gibi keşfedebilir ve çağırabilir. Bir ürün araması mı? Bu bir fonksiyon çağrısıdır. Bir ödeme süreci mi? Bir API isteğidir. WebMCP sadece sayfaları isteğe bağlı hale getirmiyor; web sayfasının ayrı bir içerik birimi konseptini ortadan kaldırıyor, onu çağrılabilir yetenekler topluluğuyla değiştiriyor.

Bu yaklaşımların her biri mimari olarak farklı olsa da, varış noktası aynı: bildiğimiz şekliyle web sayfası, ya anında oluşturuluyor, yapılandırılmış arayüzler aracılığıyla sorgulanıyor ya da tamamen baypas ediliyor. İnsan tarafından tasarlanmış, insan tarafından yayınlanmış web sayfası artık bilgi ve ticaret için tek kanal değil.

Talep Tarafı: Aracılar Yeni Tarayıcılar, Alıcılar ve Yapıcılar Olarak

Talep tarafında – web ile etkileşim kuran kullanıcılar – değişim daha da dik bir şekilde yaşandı. 2024 yılında, botlar on yılın ilk kez insan trafiğini geçti ve tüm web faaliyetlerinin %51’ini oluşturdu. Bu başlı başına bir haber, ancak Cloudflare verileri, yapay zeka “kullanıcı eylemi” taramasının (sadece pasif olarak indekslemek yerine aktif olarak görevleri yerine getiren aracılar) 2025 boyunca şaşırtıcı bir şekilde 15 kat arttığını ortaya koyuyor. Gartner’ın projeksiyonları da eşit derecede dikkat çekici: 2026’nın sonunda kurumsal uygulamaların %40’ı görev odaklı yapay zeka aracılara sahip olacak, bu da 2025’teki %5’in altından muazzam bir sıçrama. Bu otomatik aktivitenin ölçeği neredeyse tam olarak kavramak imkansız.

Aracılı tarayıcılar en görünür tezahürü. Chrome’un otomatik tarama özelliği, 3 milyar kurulumunu etkili bir şekilde potansiyel yapay zeka aracı başlatma rampalarına dönüştürdü. Google’ın kendi Gemini’si, Chrome içinde zaten kaydırıyor, tıklıyor, form dolduruyor ve otonom olarak çok adımlı görevleri tamamlıyor. Perplexity’nin Comet tarayıcısı, birden fazla sitede aynı anda derin araştırmalar yaparak sınırı zorluyor. Microsoft’un Edge Copilot Modu, kenar çubuğundan karmaşık çok adımlı iş akışlarını doğrudan yönetiyor. Aracılı tarayıcı manzarası artık kalabalık; insan kullanıcılar adına web’i özenle tarayan bir düzineden fazla tüketici ve geliştirici aracı barındırıyor.

Ve ticaret aracıları? Basit taramanın ötesine geçtiler ve aktif olarak satın alma işlemlerine katılıyorlar. OpenAI’nin Stripe’ın Aracılı Ticaret Protokolü (ACP) destekli ilk Instant Checkout denemesi, dürüst olmak gerekirse, muhteşem bir başarısızlıktı. Neredeyse sıfır satın alma dönüşümü ve vaat edilen milyondan sadece bir düzine tüccar entegrasyonu. Başarısızlık konseptte değil, uygulamadaydı. Alibaba’nın Qwen uygulaması ise tam tersine, Şubat 2026’da sadece altı gün içinde şaşırtıcı bir şekilde 120 milyon sipariş işledi; çünkü Alibaba tüm yığını kontrol ediyor: yapay zeka modeli, pazar yeri, ödeme kanalları (Alipay) ve lojistik. OpenAI, kritik altyapıya sahip olmadan aracılı ticareti denedi.

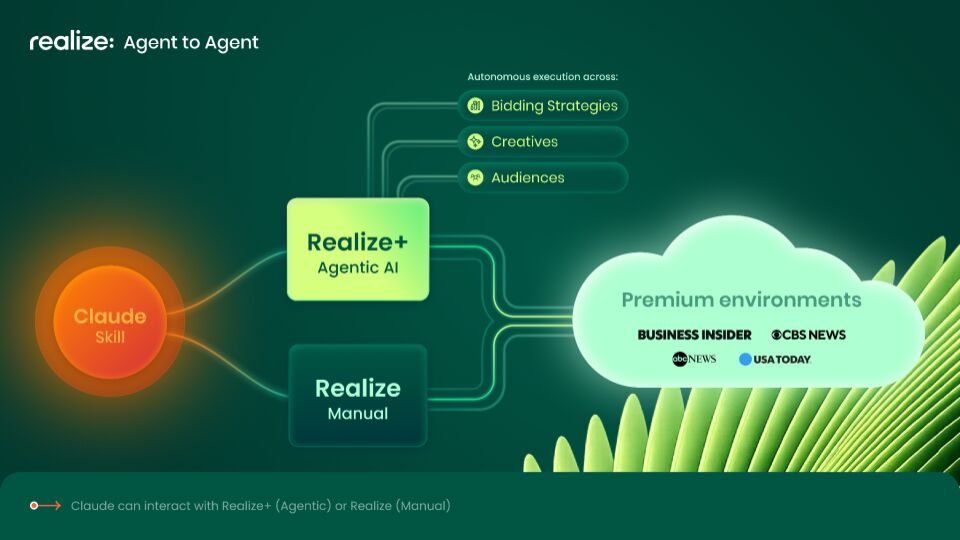

İşte burada Google ve Shopify’ın Evrensel Ticaret Protokolü (UCP) devreye giriyor. Bu çerçeve, Walmart ve Target gibi perakende devleri ile Mastercard gibi ödeme işlemcileri dahil olmak üzere 20’den fazla büyük şirketi bağlıyor; hepsi yapay zeka araçlarının keşiften ödemeye kadar tüm ticaret yolculuğunu yönetmesi için tasarlanmış. Shopify’ın ChatGPT, Copilot ve Perplexity gibi platformlarda bir milyondan fazla tüccarı otomatik olarak aracılı alışveriş deneyimlerine kaydetme hamlesi, yönü vurguluyor. İşlem genellikle bir yapay zeka sohbeti içinde gerçekleşiyor, bu da tamamen geleneksel bir ödeme sayfasının ihtiyacını ortadan kaldırıyor.

Aracılar arasındaki iletişim, insanı her iki uçtan da çıkarır.

Bu aracılar arasındaki iletişimin evrimi belki de en derin yönüdür. Bu sadece yapay zekanın insanlar adına hareket etmesiyle ilgili değil; yapay zekanın diğer yapay zekalarla etkileşime girmesiyle ilgili, insan gözetimi veya katılımından tamamen bağımsız olarak çalışabilen tamamen yeni bir dijital aktivite katmanı yaratıyor.

Mimari Yeniden Yazımı: Köprülerden API Çağrılarına

Tanık olduğumuz şey, webin altında yatan mimarinin temelden yeniden yazılmasıdır. World Wide Web’in temel unsuru olan köprü (hyperlink), hızla eski bir yapı haline geliyor. Farklı belgeler arasında gezinmek için insan merkezli bir mekanizmaydı. Ortaya çıkan aracılı webde, eşdeğer mekanizma genellikle bir API çağrısı veya yapılandırılmış bir veri sorgusudur.

Düşünün: köprü sizi bir sayfaya götürür. Bir API çağrısı sizi belirli bir fonksiyona veya veri setine götürür. Bu ayrım kritiktir. Bir sayfa, dinamik olsa bile, yarı otonom bir birimdir. Bir API uç noktası, bir görevi yerine getirmek veya belirli bilgileri almak için doğrudan bir talimattır. Belge alımından işlev yürütmeye bu geçiş, mimari değişimin özüdür.

Bu durumun AdTech için sonuçları şaşırtıcıdır. Geleneksel programatik reklamcılık, insan okunabilir web sayfalarında insan kullanıcıları tanımlama, izleme ve reklam sunma yeteneğine dayanır. Eğer sayfalar yapay zeka tarafından oluşturulmuş ve her etkileşime özgü olacak kadar kişiselleştirilmişse ve eğer ziyaretçiler görevleri yerine getiren yapay zeka aracılarsa, reklam sunumu ve ölçümünün yerleşik modelleri çökmeye başlar. İnsan tarafından okunabilir bir biçimde var olmayan bir sayfaya nasıl reklam hedeflersiniz? Eğer ‘ziyaretçi’ bir insan adına işlem yapan bir yapay zeka ise, etkinin ölçüsünü nasıl alırsınız?

Bu, İnsan Üretimi İçeriğin Sonu mu?

Tamamen değil. Ancak webdeki içeriğin baskın veya birincil biçimi olarak insan üretimi içeriğin sonunu işaret ediyor. Matbaa gibi düşünün: sözlü gelenekleri ortadan kaldırmadı, ama kesinlikle rollerini ve yaygınlıklarını değiştirdi. Muhtemelen bir çatallanma göreceğiz. Bir yanda, belirli kitleler için yüksek oranda kürate edilmiş, insan tarafından yazılmış içerik (üst düzey gazetecilik, zanaatkar el sanatları, özel topluluklar düşünün). Diğer yanda ise, işlem amaçlı, bilgi alma ve otomatik görevler için geniş, makine tarafından üretilmiş, makine tarafından tüketilen bir web.

Temel fark niyettir. İnsan içeriği genellikle ifade, bağlantı kurma veya ikna etme amacıyla oluşturulur. Yapay zeka tarafından üretilen içerik, özellikle Google’ın patenti veya aracılı ticaret bağlamında, belirli bir sonuç için optimize edilmiştir: dönüşüm, görev tamamlama, verimlilik. Oluşturmayı yönlendiren temel niyet temelde farklıdır.

Bu değişim uzak bir bilim kurgu konsepti değil. Altyapı şu anda inşa ediliyor. Google’ın patenti bir taslak. Microsoft’un NLWeb’i bir API. OpenAI’nin erken deneyleri, Alibaba’nın başarısı ve UCP’nin endüstri desteği, hepsi aynı bulmacanın parçaları. Geleceğin webi algoritmalar tarafından mimarlandırılıyor ve aracılar tarafından dolduruluyor.

🧬 İlgili İçgörüler

- Daha Fazlasını Okuyun: Yayıncılar, Programatik’in Açgözlü Aracılarından Kurtulmak İçin Güçlerini Birleştiriyor

- Daha Fazlasını Okuyun: ATT Beş Yaşında: iOS Pazarlamacıları SKAN’ın Hayatta Kalması Konusunda Bölünmüş Durumda, Apple’ın Bir Sonraki Hamlesi Yaklaşıyor

Sıkça Sorulan Sorular

Google’ın US12536233B1 patenti aslında ne yapıyor? Google’ın web sitesi açılış sayfalarını otomatik olarak puanlayabilen bir sistemi tarif ediyor. Bir sayfa dönüşüm veya hemen çıkma oranı gibi metrikler bazında düşük performans gösterirse, Google reklamverenin onayını almadan arama yapan kişi için kişiselleştirilmiş bir yapay zeka alternatifi üretebilir ve potansiyel olarak organik sonuçları özel yapay zeka versiyonlarıyla değiştirebilir.

Yapay zeka aracılar insan web sitesi ziyaretçilerini mi değiştirecek? Bu doğrudan bir değişimden ziyade trafik kompozisyonunda önemli bir kaymadır. Botlar zaten insan trafiğini geride bıraktı ve göz atma, alışveriş yapma ve işlem yapma gibi eylemleri gerçekleştiren yapay zeka aracılar hızla artıyor, bu da web faaliyetlerinin önemli bir kısmının insan dışı olacağı anlamına geliyor.

Bu çevrimiçi reklamcılığı nasıl etkiler? İnsan okunabilir sayfalarda insan kullanıcıları tanımlama ve onlara reklam sunma yeteneğine dayanan mevcut programatik reklamcılık modeli, bir aksaklıkla karşı karşıyadır. Yapay zeka tarafından oluşturulan sayfalar ve ziyaretçiler olarak yapay zeka aracılar, hedefleme, ölçüm ve reklam oluşturma için tamamen yeni yaklaşımlar gerektirir.