Вот цифра, которая должна заставить любого маркетолога или веб-разработчика задуматься: в январе 2026 года Google получил патент US12536233B1. Это не просто очередная бюрократическая бумажка; в нём детально описана система оценки посадочных страниц на основе коэффициента конверсии, показателя отказов и качества дизайна. А если страница, или, скорее, когда страница, не проходит тест? Google может создать AI-замену, персонализированную под конкретного искателя. Фишка? Рекламодатель может об этом даже не узнать.

Отрасль уже рвёт на себе волосы, обсуждая масштабы патента – только ли для товарной рекламы он предназначен, или за ним кроется что-то более зловещее? Это совершенно неверная постановка вопроса. Настоящий сейсмический сдвиг не в том, что охватывает патент, а в том, что он позволяет, когда вы соединяете страницы, сгенерированные AI, с AI-агентами, способными просматривать, покупать и совершать транзакции от нашего имени.

Мы стоим перед лицом веба, где создатель страницы – не человек, и посетитель – тоже не человек. Обе стороны. Подумайте об этом на секунду. Это полностью меняет само понятие «онлайн-присутствия».

Сторона предложения: страницы, созданные алгоритмами, а не мастерами

Сколько существует интернет, «сторона предложения» – создание контента, дизайн страниц – была фундаментально человеческой. Кто-то писал код. Кто-то писал тексты. Кто-то нажимал «опубликовать». Три отдельных, но пересекающихся, развития разрушают эту парадигму.

Патент Google, конечно, является наиболее прямым ударом. Он явно описывает архитектуру для AI, позволяющую динамически оценивать и заменять низкоэффективные посадочные страницы. Заменяющие страницы, что крайне важно, используют всю историю поисковика – прошлые запросы, поведение при кликах, местоположение, данные устройства. Это не просто персонализация; это гипер-индивидуализация в масштабах, которые ни одному человеку-рекламодателю не достичь.

Как отметил Барри Шварц из Search Engine Land, Google мог бы «автоматически создавать пользовательские посадочные страницы, заменяющие органические результаты». Гленн Гейб даже назвал это «потенциально более спорным, чем AI Overviews». В то время как некоторые, как Роджер Монтти из Search Engine Journal, настаивают на ограниченной сфере применения для товаров и рекламы, основная технология – оценка и замена страниц с помощью AI – очевидно существует и функционирует.

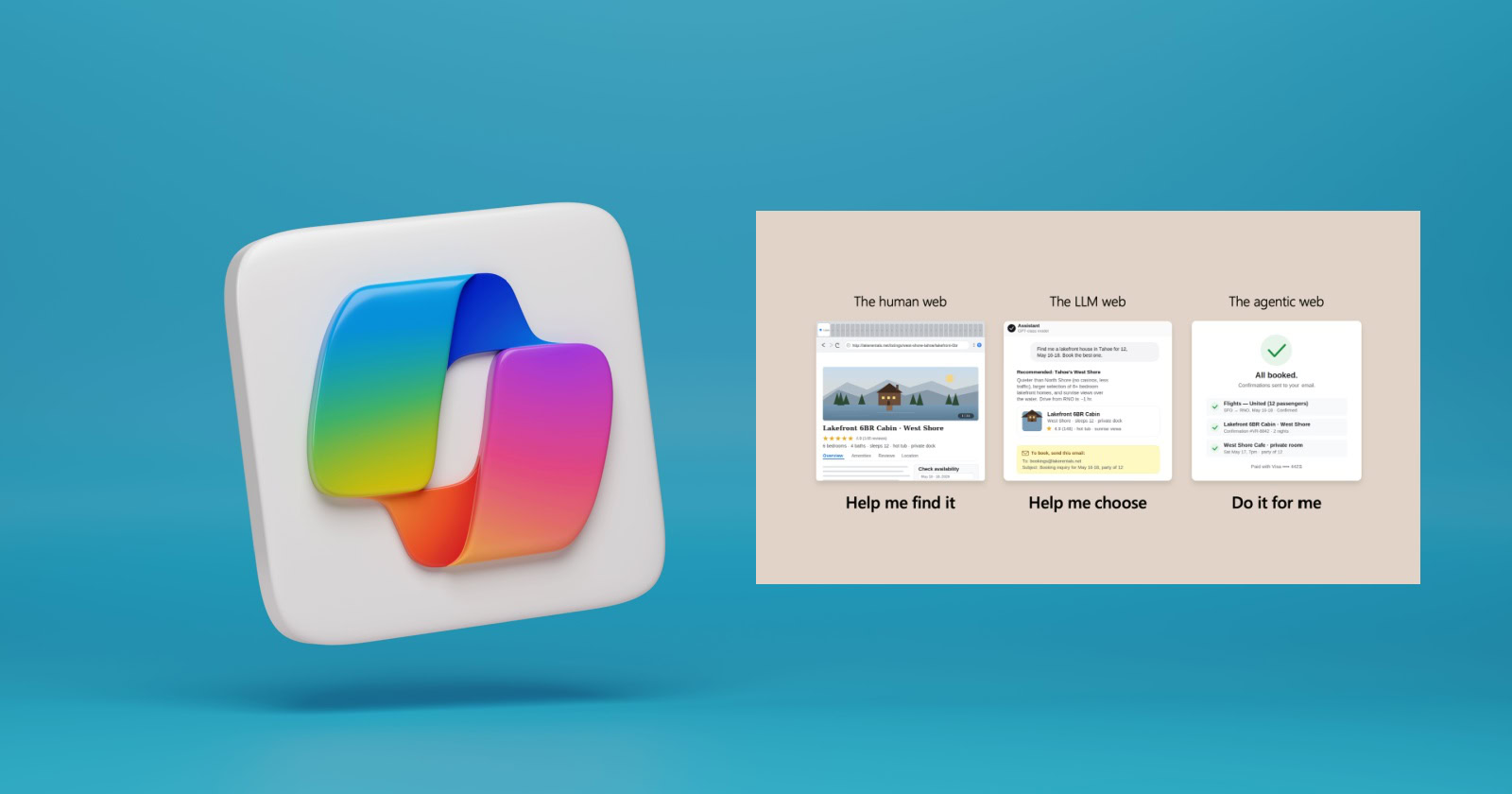

Но Google – не единственный игрок, перестраивающий слой контента. Open-source проект Microsoft, NLWeb, предлагает другой путь. Он преобразует существующие веб-сайты в интерфейсы на естественном языке, используя разметку Schema.org и RSS-ленты. Когда AI-агент запрашивает сайт с поддержкой NLWeb, он не загружает традиционную страницу. Вместо этого он задаёт структурированный вопрос, а NLWeb возвращает структурированный ответ. Отрендеренная страница становится, буквально, опциональной.

WebMCP углубляет это растворение. Здесь веб-сайты регистрируют свои инструменты с определёнными схемами ввода/вывода. AI-агенты могут находить и вызывать эти инструменты как функции. Поиск товара? Это вызов функции. Процесс оформления заказа? Запрос API. WebMCP не просто делает страницы опциональными; он искореняет само понятие веб-страницы как отдельной единицы контента, заменяя его набором вызываемых возможностей.

Каждый из этих подходов архитектурно различен, но пункт назначения один: веб-страница, как мы её знаем, либо генерируется на лету, либо запрашивается через структурированные интерфейсы, либо полностью обходится. Веб-страница, разработанная и опубликованная человеком, больше не является единственным каналом информации и коммерции.

Сторона спроса: агенты как новые браузеры, покупатели и исполнители

На стороне спроса – пользователи, взаимодействующие с вебом – сдвиг был ещё более головокружительным. В 2024 году боты впервые за десятилетие превысили человеческий трафик, составив 51% всей веб-активности. Это само по себе новость, но данные Cloudflare показывают, что «пользовательские действия» AI-краулинга (агенты, активно выполняющие задачи, а не просто пассивно индексирующие) выросли поразительно в 15 раз в течение 2025 года. Прогнозы Gartner также впечатляют: к концу 2026 года 40% корпоративных приложений будут иметь специализированных AI-агентов, что является монументальным скачком по сравнению с менее чем 5% в 2025 году. Абсолютный масштаб этой автоматизированной деятельности почти невозможно полностью осознать.

Агентские браузеры – наиболее очевидное проявление. Функция авто-браузинга Chrome фактически превратила его 3 миллиарда установок в потенциальные стартовые площадки для AI-агентов. Gemini от Google, внутри Chrome, уже прокручивает, кликает, заполняет формы и автономно выполняет многошаговые задачи. Браузер Perplexity Comet расширяет границы, проводя глубокие исследования на нескольких сайтах одновременно. Режим Edge Copilot от Microsoft обрабатывает сложные многошаговые рабочие процессы непосредственно из боковой панели. Ландшафт агентских браузеров теперь переполнен: более дюжины потребительских и разработческих инструментов, все усердно просматривают веб от имени пользователей.

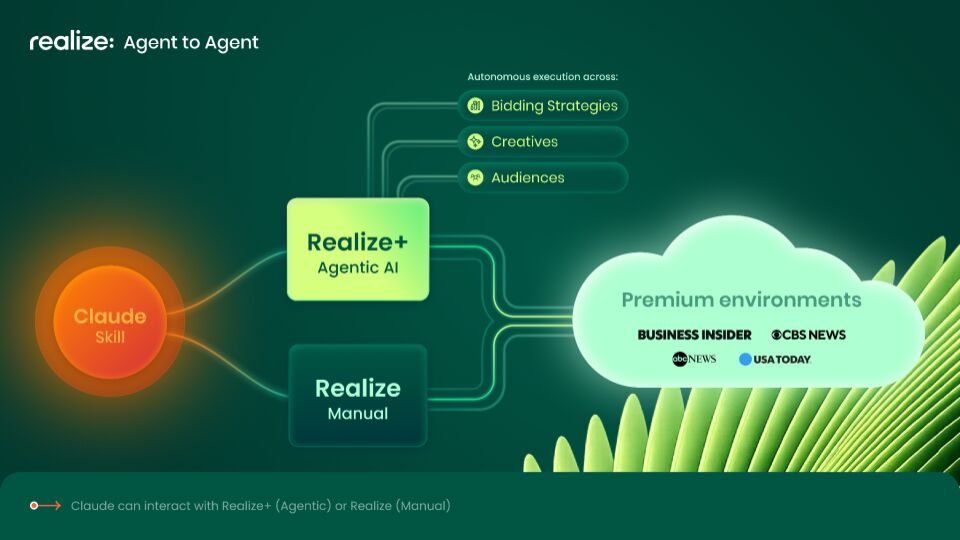

А торговые агенты? Они вышли за рамки простого просмотра и активно занимаются покупками. Первоначальная попытка OpenAI с Instant Checkout, работающая на Agentic Commerce Protocol (ACP) от Stripe, была, честно говоря, spektakuläre flop. Околонулевые конверсии покупок и жалкие дюжины интеграций с продавцами из обещанного миллиона. Провал был не в концепции, а в реализации. Приложение Qwen от Alibaba, напротив, обработало поразительные 120 миллионов заказов всего за шесть дней в феврале 2026 года, именно потому, что Alibaba контролирует весь стек: AI-модель, маркетплейс, платёжные каналы (Alipay) и логистику. OpenAI пыталась реализовать агентскую коммерцию, не владея критически важной инфраструктурой.

Вот где Google и Universal Commerce Protocol (UCP) от Shopify вступают в игру. Эта структура объединяет более 20 крупных компаний, включая розничных гигантов вроде Walmart и Target, а также платёжные процессоры, такие как Mastercard, все они предназначены для того, чтобы AI-агенты управляли всем процессом коммерции — от поиска до оформления заказа. Шаг Shopify по автоматическому включению более миллиона продавцов в агентские торговые возможности на платформах вроде ChatGPT, Copilot и Perplexity подчеркивает направление. Транзакция часто происходит в рамках AI-диалога, делая традиционную страницу оформления заказа полностью ненужной.

Взаимодействие между агентами исключает человека с обоих концов.

Эта эволюция взаимодействия между агентами, пожалуй, самый глубокий аспект. Это не просто AI, действующий от имени людей; это AI, взаимодействующий с другими AI, создавая совершенно новый пласт цифровой активности, который может работать полностью независимо от человеческого контроля или участия.

Архитектурная перестройка: от гиперссылок к вызовам API

То, что мы наблюдаем, — это фундаментальная перестройка базовой архитектуры веба. Гиперссылка, основополагающий элемент Всемирной паутины, быстро становится устаревшим конструктом. Это был человеко-ориентированный механизм для навигации между отдельными документами. В формирующемся агентском вебе эквивалентным механизмом часто является вызов API или структурированный запрос данных.

Подумайте об этом: гиперссылка ведёт вас на страницу. Вызов API ведёт вас к конкретной функции или набору данных. Это различие критически важно. Страница, даже динамическая, является полуавтономной единицей. Конечная точка API — это прямая инструкция выполнить задачу или получить конкретную информацию. Этот переход от извлечения документов к выполнению функций — суть архитектурных изменений.

Последствия для AdTech ошеломляют. Традиционная программная реклама опирается на способность идентифицировать, отслеживать и показывать рекламу человеческим пользователям на страницах, читаемых человеком. Если страницы генерируются AI и персонализируются до такой степени, что становятся уникальными для каждого взаимодействия, и если посетители — это AI-агенты, выполняющие задачи, то установленные модели доставки и измерения рекламы начинают рушиться. Как вы можете таргетировать рекламу на страницу, которая не существует в форме, читаемой человеком? Как измерить эффект, если «посетитель» — это AI, выполняющий транзакцию от имени человека?

Это конец контента, созданного человеком?

Не совсем. Но это сигнализирует конец контента, созданного человеком, как доминирующей или первичной формы контента в вебе. Думайте об этом как о книгопечатании: оно не устранило устные традиции, но, безусловно, изменило их роль и распространенность. Вероятно, мы увидим бифуркацию. С одной стороны, высоко курируемый контент, созданный человеком для определённых аудиторий (премиум-журналистика, ремесленные изделия, специализированные сообщества). С другой – обширный, генерируемый машиной и потребляемый машиной веб для транзакционных целей, поиска информации и автоматизированных задач.

Ключевое отличие — намерение. Контент, созданный человеком, часто создается для выражения, связи или убеждения. Контент, сгенерированный AI, особенно в контексте патента Google или агентской коммерции, оптимизирован для конкретного результата: конверсии, выполнения задачи, эффективности. Фундаментальное намерение, движущее созданием, принципиально иное.

Этот сдвиг — не далёкая научно-фантастическая концепция. Инфраструктура строится сейчас. Патент Google — это чертёж. NLWeb от Microsoft — это API. Ранние эксперименты OpenAI, успех Alibaba и отраслевая поддержка UCP — всё это части одной головоломки. Веб будущего проектируется алгоритмами и населяется агентами.

🧬 Связанные идеи

- Читать больше: Издатели объединяют усилия, чтобы лишить алчных посредников программатик-рекламы

- Читать больше: ATT пять лет спустя: маркетологи iOS разделились по вопросу выживания SKAN, назревает следующий шаг Apple

Часто задаваемые вопросы

Что на самом деле делает патент Google US12536233B1? Он описывает систему, где Google может автоматически оценивать посадочные страницы веб-сайтов. Если страница показывает низкую эффективность по таким метрикам, как конверсия или показатель отказов, Google может сгенерировать персонализированную AI-замену для искателя без одобрения рекламодателя, потенциально заменяя органические результаты пользовательскими AI-версиями.

Заменят ли AI-агенты посетителей веб-сайтов? Речь идёт не о прямой замене, а о значительном сдвиге в составе трафика. Боты уже превысили человеческий трафик, и AI-агенты, выполняющие такие действия, как просмотр, покупки и транзакции, стремительно увеличиваются, что означает, что значительная часть веб-активности будет нечеловеческой.

Как это повлияет на онлайн-рекламу? Существующая модель программной рекламы, зависящая от идентификации и показа рекламы человеческим пользователям на страницах, читаемых человеком, сталкивается с серьёзными изменениями. AI-генерируемые страницы и AI-агенты как посетители требуют совершенно новых подходов к таргетингу, измерению и созданию рекламы.